随机信号处理笔记-第四章:自适应滤波

自适应滤波(Adaptive filter, AF)是指根据信号环境特性用递推算法(自适应算法)自动调整滤波器中的脉冲响应,使自适应滤波器的输出尽可能接近期望输出。在平稳环境中,迭代次数充分大时,自适应算法的结果在某种统计意义上收敛于最优的维纳解。在非平稳环境中,自适应算法具有一定的跟踪输入数据统计特性变换的能力。

自适应滤波器的特点为权值是时变的。

1. 自适应滤波器的应用

考试要求能画图

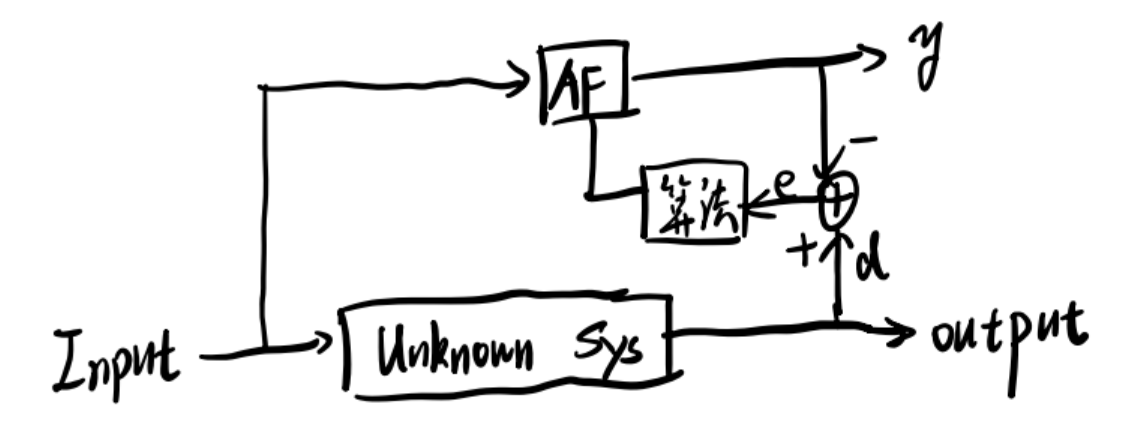

1.1 系统辨识

自适应滤波用于系统辨识的原理是给未知系统和AF同一个输入,使AF的输出

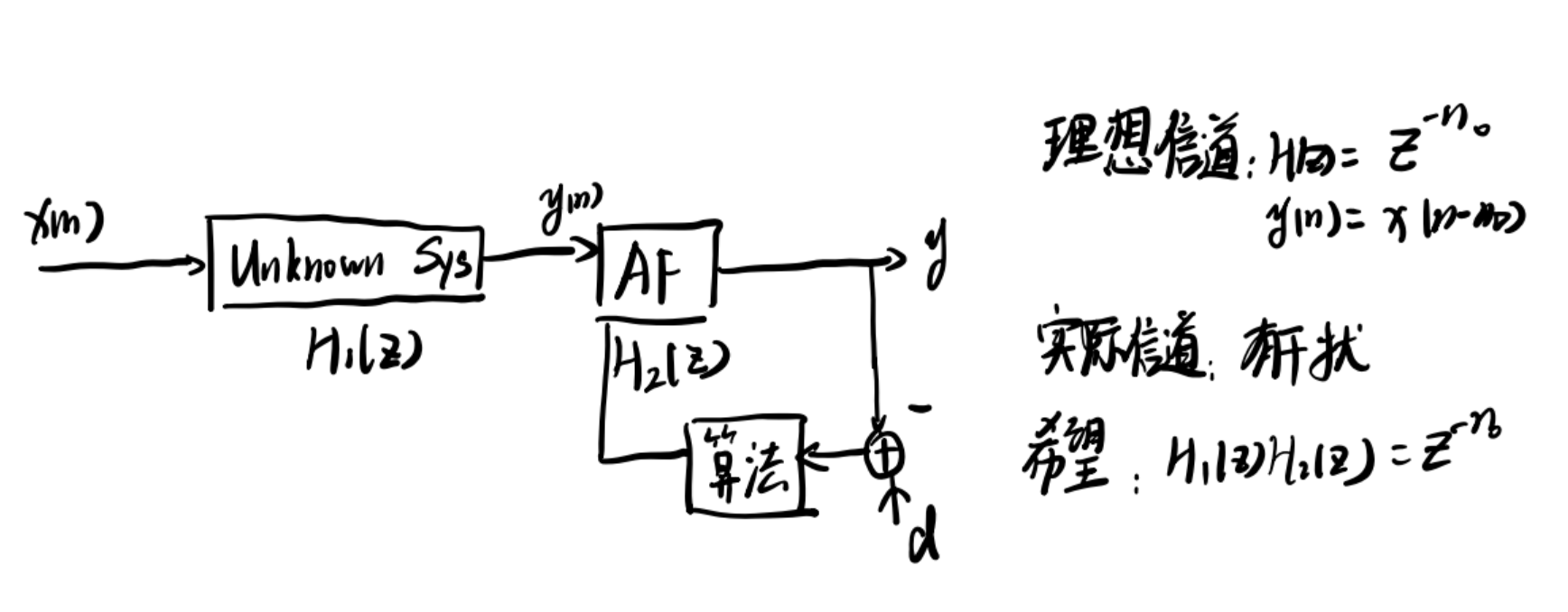

1.2 逆滤波

逆滤波也称均衡器,可以用来抵消信道干扰。这里期望信号为

2. 最速下降(SDA)

如果接触过机器学习中的梯度下降算法应该对这一节比较熟悉。

最速下降的原理是通过朝负梯度方向迭代使得滤波器

其中

2.1 步长与收敛速度

为了保证滤波器收敛,步长

其中

条件数

2.2 最速降下降与维纳滤波

现在,若已知

- 维纳滤波:

,这种方法存在解析解,但需要对矩阵求逆 - 最速下降:

,不用对矩阵求逆,但需要迭代

3. LMS自适应滤波

3.1 LMS滤波原理

Least-Mean-Square,LMS自适应滤波是对最速下降法的改进。最速下降需要提前知道整个输入数据的自相关

所谓的瞬时值,就是去掉了期望计算

LMS核心三大公式如下

| 含义 | 公式 |

|---|---|

| 滤波输出 | |

| 误差 | |

| 权值更新 |

也就是说,在LMS中,瞬时梯度为

滤波器输出有

3.2 LMS的MSE

LMS的MSE由三个部分组成

这里我们关心的的是时间步

显然性能下降了。

引入的超量误差

也就是说步长越小,超量MSE就会越小,但相应的收敛速度也会越慢

我们定义失调量

3.4 LMS与最速下降的联系与区别

LMS是基于最速下降的改进算法,它不需要提前知道所有输入数据的统计特征,而是根据每一次单个的数据调整权重,因此LMS的梯度是随机的。

3.5 LMS的改进

LMS有三种基本的改进思想

| 方法 | 描述 |

|---|---|

| 归一化 | 将步长 |

| 去相关(白化) | 将输入信号 |

| 子带域适应 |

4. 递推最小二乘(RLS)

4.1 RLS原理

Recursive Least Squares,RLS递推最小二乘是在最小二乘的基础上加入遗忘因子,使算法具有跟踪新数据的能力。

遗忘因子的作用是对误差进行指数加权

其中

同样对MSE求偏导令其等于0,简单移项整理可得

等式左边除去滤波器

等式右边为加权时间平均互相关,称为

可以得到滤波器表达式为

显然,这个式子和维纳滤波的时域解是一致的,不过所有的参数都是时变的。既然滤波器是时变的,与上一次滤波器系数相关,那么

4.2 RLS的优缺点

优点:

- 收敛快

- 收敛速度对输入自相关

缺点:

- 计算量大,RLS计算复杂度为

5. 自适应滤波器的应用

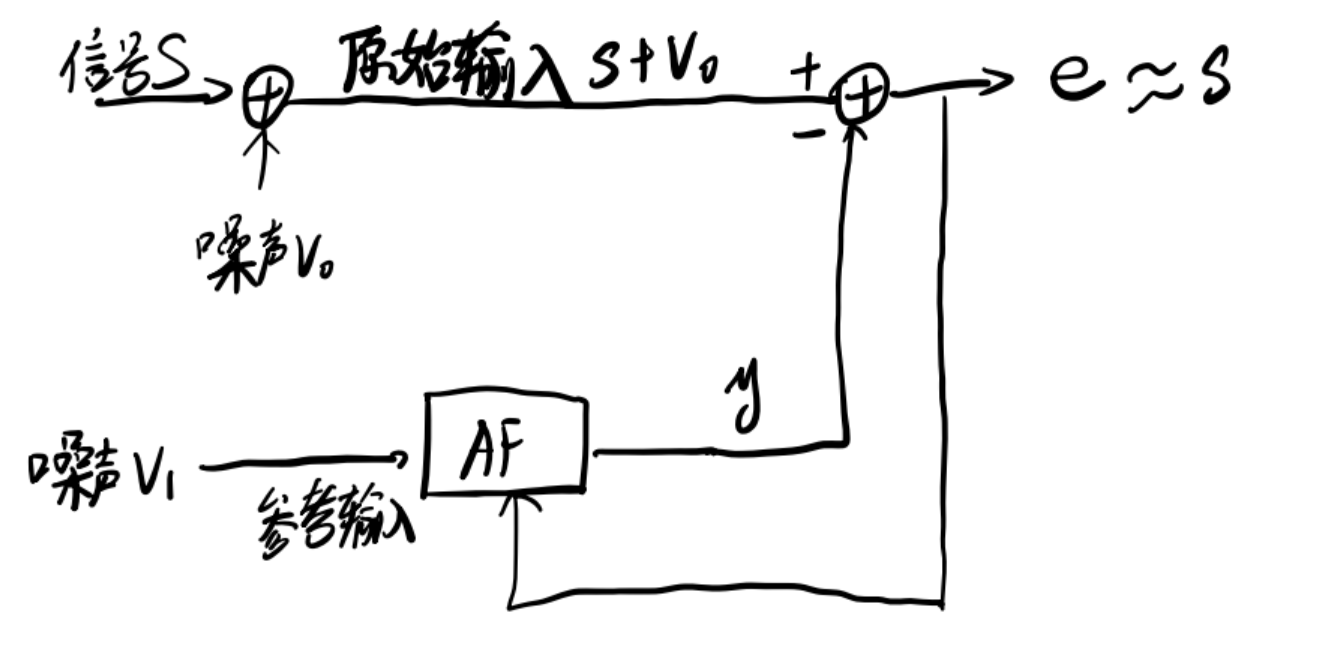

自适应滤波器的应用场合很多,这里以自适应噪声抵消器(Adaptive Noise Canceller)为例。

自适应噪声抵消器的原理是使用一个自适应滤波器去学习噪声的输入模式。在这幅图中体现为用一个AF和参考输入

实际上噪声

第一项等于0的原因是正交性原理

所以二者等价

自适应噪声抵消器起作用需要有两个条件:

- 参考输入没有或者只有少量信号

条件2很好理解,主要看一下条件1。

针对条件1可以进一步提出一个问题:若

首先很显然有这样一个结论:信号

接下来看一下误差的组成

因此,最小化AF误差就相当于最小化

从频率响应的角度,如果